清华团队用一万块钱让7B模型数学打败GPT4o

- 量子位

- 2025-01-14 03:48:45

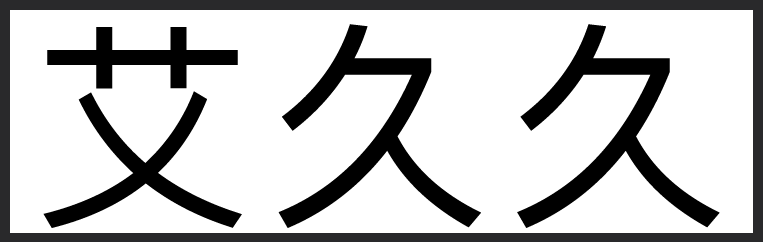

清华团队用一万块钱让7B模型数学打败GPT4o

OpenAI o1和o3模型的发布证明了强化学习能够让大模型拥有像人一样的快速迭代试错、深度思考的高阶推理能力,在基于模仿学习的Scaling Law逐渐受到质疑的今天,基于探索的强化学习有望带来新的Scaling Law。

近日,清华大学NLP实验室、上海AI Lab、清华大学电子系、OpenBMB社区等团队提出一种新的结合过程奖励的强化学习方法——PRIME(Process Reinforcement through IMplicit REwards)。

采用PRIME方法,研究人员不依赖任何蒸馏数据和模仿学习,仅用8张A100,花费一万块钱左右,不到10天时间,就能高效训练出一个数学能力超过 GPT-4o、Llama-3.1-70B的7B模型 Eurus-2-7B-PRIME。

具体而言,研究人员利用Qwen2.5-Math-7B-Base作为基座模型,训练出了新模型Eurus-2-7B-PRIME,并在美国IMO选拔考试AIME 2024上的准确率达到26.7%,大幅超越GPT-4o,Llama3.1-70B和Qwen2.5-Math-7B-Instruct,且仅使用了Qwen Math数据的 1/10。其中,强化学习方法PRIME为模型带来了16.7%的绝对提升,远超已知的任何开源方案。

该项目一经开源就在海外AI社区爆火,短短几天Github取得近300star。

未来,基于PRIME方法和更强的基座模型有潜力训练出接近OpenAI o1的模型。

仅需一万块钱!清华团队靠强化学习让 7B模型数学打败GPT-4o

仅需一万块钱!清华团队靠强化学习让 7B模型数学打败GPT-4o

OpenAI o1和o3模型的发布证明了强化学习能够让大模型拥有像人一样的快速迭代试错、深度思考的高阶推理能力,在基于模仿学习的Scaling Law逐渐受到质疑的今天,基于探索的强化学习有望带来新的Scaling Law。

近日,清华大学NLP实验室、上海AI Lab、清华大学电子系、OpenBMB社区等团队提出一种新的结合过程奖励的强化学习方法——PRIME(Process Reinforcement through IMplicit REwards)。

采用PRIME方法,研究人员不依赖任何蒸馏数据和模仿学习,仅用8张A100,花费一万块钱左右,不到10天时间,就能高效训练出一个数学能力超过 GPT-4o、Llama-3.1-70B的7B模型 Eurus-2-7B-PRIME。

具体而言,研究人员利用Qwen2.5-Math-7B-Base作为基座模型,训练出了新模型Eurus-2-7B-PRIME,并在美国IMO选拔考试AIME 2024上的准确率达到26.7%,大幅超越GPT-4o,Llama3.1-70B和Qwen2.5-Math-7B-Instruct,且仅使用了Qwen Math数据的 1/10。其中,强化学习方法PRIME为模型带来了16.7%的绝对提升,远超已知的任何开源方案。

该项目一经开源就在海外AI社区爆火,短短几天Github取得近300star。

未来,基于PRIME方法和更强的基座模型有潜力训练出接近OpenAI o1的模型。

仅需一万块钱!清华团队靠强化学习让 7B模型数学打败GPT-4o

仅需一万块钱!清华团队靠强化学习让 7B模型数学打败GPT-4o