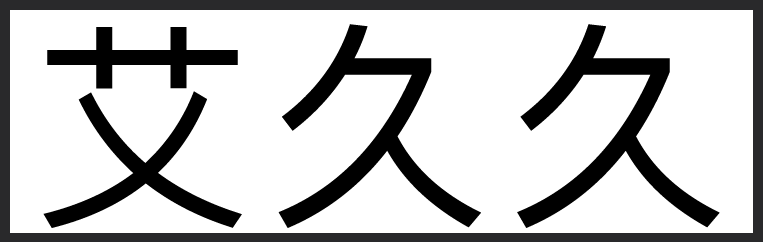

“废墟男孩”系伪造,#警惕AI造谣成次生灾害#

- 扬子晚报

- 2025-01-11 08:23:58

【“废墟男孩”系伪造,警惕AI造谣成次生灾害】1月7日,西藏定日县发生6.8级地震。在许多网友为灾民祈福同时,社交平台上却出现了一张“被压废墟下的小男孩”,配文均与日喀则地震关联。不过,后经证实,该图片系由AI生成。AI生成地震小孩被埋警惕虚假信息余震

帽子与毛衣的斑斓色彩、黑灰色的建筑废墟、小男孩的稚态与痛苦表情构成一幅极具视觉冲击力的照片,迅速勾起人们的同情心。一张配图,看似激起了公众救灾热情,但却产生了负面风险隐患。准确信息事关救灾资源分配,尤其是西藏灾区,寒冬腊月、高寒缺氧、远离大城市,信息交流、资源投放不容易,生死时速中,救灾抢险可能因为谣言而资源错配。“造谣一张嘴、辟谣跑断腿”,救灾还要拿出时间核实信息、发布真相,免不了要占用当地人力、精力。

今天,“有图未必有真相”,天灾人祸时更是AI图“集中作妖”时期,地震过后,往往有信息混乱、谣言满天飞的“余震”。这次地震,“AI造谣”图片远不只一张,有满目楼房垮塌的废墟,有妈妈为孩子顶住压力的“感人图片”,有滚滚浓烟中号召大家祈福的煽情图样,版本和配文各不相同,任其发展,不排除会造成不可挽回次生灾害。实际上,每到类似灾情,也是一些人借事生非的“窗口期”。“开局一张图、内容全靠编”,目的就是博眼球、引流量。明星艺人有了绯闻,都还要歉意满满说上一句“很抱歉占用了公共资源”,这帮人却在造谣传谣后“事了拂衣去”。

专家坦言,“‘生成式AI’的拼接本质和谣言有很强的亲近性”,因为都是拼接,即不加管控,AI天然契合造谣。有记者体验发现,很多软件生成内容无风险提示,且在图片、视频发出约一小时后,平台才标注“疑似使用AI生成技术”。在内容制作、发布端,均有较大风险漏洞。对此,平台有必要通过落实AI生成标识强制标注,在发布内容前后都应进行必要审核、标注,向浏览过谣言的用户智能推送辟谣内容等,以降低谣言破坏力。同时,鉴于AI造谣具有门槛低、批量化、成本小等特点,如果能通过技术手段,让普通用户能设法查验真伪,AI伪造内容无疑会得到更广泛监督、更及时纠治。

恰如《南方周末》AI主题的献词所言,“这一年,AI更多风险,从人类安全、伦理,蔓延至社会的方方面面。”的确,在内容制作上,AI技术进步有目共睹、超乎预期,更关键的是,这远不是AI的极限,它像一个进步神速的制图师,可以总结规律、拼接情节、不断精进,今天细心的网友或可从“小孩有六根手指”中看出“废墟男孩”的造假端倪,明天这点破绽就会被AI超强的学习力所覆盖、抹杀掉。换言之,防造假的规则和机制得不到完善,指望肉眼识别、事后治理,恐怕已难以为继。AI男孩被埋图涉案人员被行拘 造谣小男孩被埋涉案人员已被拘(交汇点 韩宗峰)

帽子与毛衣的斑斓色彩、黑灰色的建筑废墟、小男孩的稚态与痛苦表情构成一幅极具视觉冲击力的照片,迅速勾起人们的同情心。一张配图,看似激起了公众救灾热情,但却产生了负面风险隐患。准确信息事关救灾资源分配,尤其是西藏灾区,寒冬腊月、高寒缺氧、远离大城市,信息交流、资源投放不容易,生死时速中,救灾抢险可能因为谣言而资源错配。“造谣一张嘴、辟谣跑断腿”,救灾还要拿出时间核实信息、发布真相,免不了要占用当地人力、精力。

今天,“有图未必有真相”,天灾人祸时更是AI图“集中作妖”时期,地震过后,往往有信息混乱、谣言满天飞的“余震”。这次地震,“AI造谣”图片远不只一张,有满目楼房垮塌的废墟,有妈妈为孩子顶住压力的“感人图片”,有滚滚浓烟中号召大家祈福的煽情图样,版本和配文各不相同,任其发展,不排除会造成不可挽回次生灾害。实际上,每到类似灾情,也是一些人借事生非的“窗口期”。“开局一张图、内容全靠编”,目的就是博眼球、引流量。明星艺人有了绯闻,都还要歉意满满说上一句“很抱歉占用了公共资源”,这帮人却在造谣传谣后“事了拂衣去”。

专家坦言,“‘生成式AI’的拼接本质和谣言有很强的亲近性”,因为都是拼接,即不加管控,AI天然契合造谣。有记者体验发现,很多软件生成内容无风险提示,且在图片、视频发出约一小时后,平台才标注“疑似使用AI生成技术”。在内容制作、发布端,均有较大风险漏洞。对此,平台有必要通过落实AI生成标识强制标注,在发布内容前后都应进行必要审核、标注,向浏览过谣言的用户智能推送辟谣内容等,以降低谣言破坏力。同时,鉴于AI造谣具有门槛低、批量化、成本小等特点,如果能通过技术手段,让普通用户能设法查验真伪,AI伪造内容无疑会得到更广泛监督、更及时纠治。

恰如《南方周末》AI主题的献词所言,“这一年,AI更多风险,从人类安全、伦理,蔓延至社会的方方面面。”的确,在内容制作上,AI技术进步有目共睹、超乎预期,更关键的是,这远不是AI的极限,它像一个进步神速的制图师,可以总结规律、拼接情节、不断精进,今天细心的网友或可从“小孩有六根手指”中看出“废墟男孩”的造假端倪,明天这点破绽就会被AI超强的学习力所覆盖、抹杀掉。换言之,防造假的规则和机制得不到完善,指望肉眼识别、事后治理,恐怕已难以为继。AI男孩被埋图涉案人员被行拘 造谣小男孩被埋涉案人员已被拘(交汇点 韩宗峰)